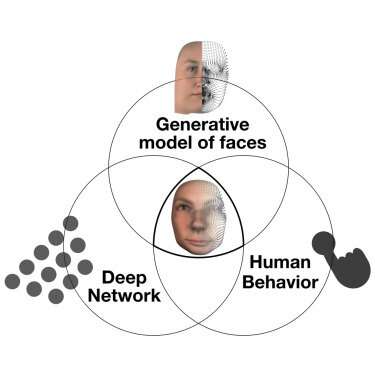

Grafische samenvatting. Krediet: DOI: 10.1016/j.patter.2021.00348

Het creëren van mensachtige kunstmatige intelligentie is meer dan alleen het simuleren van menselijk gedrag – de technologie moet ook in staat zijn om informatie te verwerken, of te “denken” als mensen om er volledig op te kunnen vertrouwen.

Nieuw onderzoek gepubliceerd in het tijdschrift patronen – tekenen Onder leiding van de School of Psychology and Neuroscience van de University of Glasgow, gebruikt het 3D-modellering om de manier te analyseren waarop diepe neurale netwerken – onderdeel van de bredere machine learning-familie – werken. Informatie, om te visualiseren hoe hun informatieverwerking overeenkomt met die van mensen.

Het is te hopen dat dit nieuwe werk de weg vrijmaakt voor de creatie van een betrouwbare kunstmatige-intelligentietechnologie die informatie zoals mensen verwerkt en fouten maakt die we kunnen begrijpen en voorspellen.

Een van de uitdagingen waarmee de ontwikkeling van AI nog wordt geconfronteerd, is hoe je het denkproces van de machine beter kunt begrijpen en of het overeenkomt met de manier waarop mensen informatie verwerken, om nauwkeurigheid te garanderen. Diepe neurale netwerken worden tegenwoordig vaak als de beste gepresenteerd Model van Menselijk Besluitvormend gedrag, het bereiken of zelfs overtreffen van menselijke prestaties bij bepaalde taken. Zelfs bedrieglijk eenvoudige visuele discriminatietaken kunnen echter duidelijke inconsistenties en fouten van AI-modellen aan het licht brengen in vergelijking met mensen.

Momenteel wordt diepe neurale netwerktechnologie gebruikt in toepassingen zoals: GezichtsherkenningEn ondanks hun succes op deze gebieden, begrijpen wetenschappers nog steeds niet helemaal hoe deze netwerken informatie verwerken, en dus wanneer er fouten kunnen optreden.

In deze nieuwe studie pakte het onderzoeksteam dit probleem aan door de visuele stimulus van het diepe neurale netwerk te modelleren en op meerdere manieren te transformeren, zodat ze gelijkenis in herkenning konden vertonen, door vergelijkbare informatie tussen mensen en het AI-model te verwerken .

“Bij het bouwen van AI-modellen die zich ‘als’ mensen gedragen, bijvoorbeeld het herkennen van het gezicht van een persoon wanneer ze zichzelf als een mens zullen zien, moeten we ervoor zorgen dat het AI-model dezelfde informatie van het gezicht gebruikt dat een ander mens gebruikt om het te herkennen. Als AI dit niet doet, kunnen we de illusie krijgen dat het systeem net als mensen werkt, maar dan merk je dat het fout gaat in een nieuwe of niet-geteste toestand.”

Met behulp van een reeks aanpasbare 3D-gezichten vroegen de onderzoekers mensen om de gelijkenis van deze willekeurig gegenereerde gezichten met vier bekende identiteiten te beoordelen. Vervolgens gebruikten ze deze informatie om te testen of diepe neurale netwerken om dezelfde redenen dezelfde classificaties maakten – niet alleen om te testen of mensen en AI dezelfde beslissingen namen, maar ook of ze op dezelfde informatie waren gebaseerd. Belangrijk is dat de onderzoekers door hun aanpak deze bevindingen kunnen visualiseren als 3D-gezichten die het gedrag van mensen en netwerken aansturen. Bijvoorbeeld, een netwerk Correct gecategoriseerd 2000 identiteiten werden grotendeels gedreven door een cartoonachtig gezicht, wat aangeeft dat ze zich identificeerden gezichten De verwerking van gezichtsinformatie is heel anders dan bij mensen.

De onderzoekers hopen dat dit werk de weg vrijmaakt voor betrouwbaardere AI Techniek Ze gedragen zich meer als mensen en maken minder onverwachte fouten.

De studie, “Aarding van diepe neurale netwerkvoorspellingen van menselijk classificatiegedrag in begrijpelijke functionele eigenschappen: de staat van gezichtsidentiteit”, is gepubliceerd in patronen – tekenen.

Christoph Daub et al., Vaststelling van diepe neurale netwerkvoorspellingen van menselijk classificatiegedrag in begrijpelijke functionele kenmerken: de staat van gezichtsidentiteit, patronen – tekenen (2021). DOI: 10.1016 / j.patter.2021.00348

Introductie van

Universiteit van Glasgow

de Quote: Een AI ontwikkelen die “denkt” als mensen (2021, 11 oktober) Ontvangen op 11 oktober 2021 van https://techxplore.com/news/2021-10-ai-humans.html

Op dit document rust copyright. Niettegenstaande elke eerlijke handel met het oog op eigen studie of onderzoek, mag geen enkel deel worden gereproduceerd zonder schriftelijke toestemming. De inhoud is uitsluitend bedoeld voor informatieve doeleinden.

More Stories

China is van plan het Tiangong-ruimtestation uit te breiden; Stel deze in op “Space Rule” omdat het ISS wordt uitgeschakeld

De Verenigde Staten detecteren het eerste geval van de H5N1-vogelgriep bij een varken, wat aanleiding geeft tot bezorgdheid voor de mens

NASA zal in 2025 de ruimtewandelingen aan boord van het internationale ruimtestation hervatten na een lek in het ruimtepak